ヴィタリック・ブテリン:Crypto+AIの応用の展望と課題

執筆:Vitalik Buterin

翻訳:Karen,Foresight News

特別感謝 Worldcoin と Modulus Labs チーム、Xinyuan Sun、Martin Koeppelmann、Illia Polosukhin のフィードバックと議論。

長年にわたり、多くの人々から「暗号通貨と AI の間で最も生産的な交差点はどこにあるのか?」という質問を受けてきました。これは合理的な質問です。暗号通貨と AI は過去10年間の2つの主要な深層(ソフトウェア)技術トレンドであり、両者の間には必ず何らかの関連性が存在します。

表面的には、両者の相乗効果を見つけるのは簡単です。暗号通貨の分散化は AI の集中化をバランスさせ、AI は不透明であり、暗号通貨は透明性をもたらします。AI はデータを必要とし、ブロックチェーンはデータの保存と追跡に優れています。しかし、何年にもわたり、具体的な応用について深く掘り下げるよう求められた際、私の答えはいつも失望を与えるものでした。「はい、確かに探求する価値のある応用はありますが、それほど多くはありません。」

過去3年間、現代の LLM(大規模言語モデル)などのより強力な AI 技術の台頭と、単なるブロックチェーンのスケーリングソリューションだけでなく、ゼロ知識証明、全同態暗号、(二者および多者)安全なマルチパーティ計算などのより強力な暗号通貨技術の台頭に伴い、私はこの変化を見始めました。ブロックチェーンエコシステム内、または AI と暗号学を組み合わせることで、確かにいくつかの有望な AI アプリケーションが存在しますが、AI を使用する際には慎重である必要があります。特に挑戦的なのは、暗号学においてオープンソースは何かを本当に安全にする唯一の方法ですが、AI においてはオープンなモデル(さらにはそのトレーニングデータ)は、その対抗的機械学習攻撃に対する脆弱性を大幅に増加させるということです。本記事では、Crypto+AI が交差する可能性のあるさまざまな方法を分類し、各分類の展望と課題を探ります。

uETH ブログ記事からの Crypto+AI 交差点の要約。しかし、具体的な応用においてこれらの相乗効果を実現するにはどうすればよいのでしょうか?

Crypto+AI の四大交差点

AI は非常に広範な概念です。AI を一連のアルゴリズムと見なすことができ、あなたが作成するアルゴリズムは明示的に指定するのではなく、大きな計算スープをかき混ぜて何らかの最適化圧力を加えることによって、あなたが望む特性を持つアルゴリズムを生成します。

この説明は決して軽視されるべきではありません。なぜなら、それは私たち人間の創造プロセスを含んでいるからです!しかし、これはまた、AI アルゴリズムがいくつかの共通の特徴を持っていることを意味します。それらは非常に強力な能力を持っている一方で、その内部の動作を理解することには限界があります。

AI を分類する方法はいくつかありますが、本記事で議論する AI とブロックチェーンの相互作用に関して(Virgil Griffith の「文字通り、イーサリアムはゲームのルールを変える技術です」記事)、私は以下のように分類します:

AI をゲームの参加者として(実現可能性が最も高い):AI が参加するメカニズムにおいて、インセンティブの最終的な源は人間の入力から来るプロトコルです。

AI をゲームのインターフェースとして(大きな可能性があるがリスクも存在):AI はユーザーが周囲の暗号世界を理解するのを助け、彼らの行動(例えば、署名されたメッセージや取引)が意図に合致するようにし、欺かれたり騙されたりするのを避けます。

AI をゲームのルールとして(非常に慎重に行動する必要がある):ブロックチェーン、DAO、類似のメカニズムが直接 AI を呼び出します。例えば、「AI 裁判官」。

AI をゲームの目標として(長期的かつ興味深い):ブロックチェーン、DAO、類似のメカニズムの目標は、他の目的に使用できる AI を構築し維持することであり、暗号技術の一部は、より良いトレーニングを促進するため、または AI がプライベートデータを漏洩したり悪用されたりするのを防ぐためです。

それでは、一つずつ振り返ってみましょう。

AI をゲームの参加者として

実際、このカテゴリーはほぼ10年前から存在しており、少なくともオンチェーンの分散型取引所(DEX)が広く使用され始めた頃から存在しています。取引所が存在する限り、アービトラージで利益を上げる機会があり、ボットは人間よりもアービトラージをうまく行うことができます。

このユースケースは長い間存在しており、現在よりもはるかに単純な AI を使用していても、最終的には AI と暗号通貨の真の交差点です。最近では、MEV(最大化可能な抽出価値)アービトラージボットが互いに利用し合うのをよく見かけます。オークションや取引が関与するブロックチェーンアプリケーションでは、常にアービトラージボットが存在します。

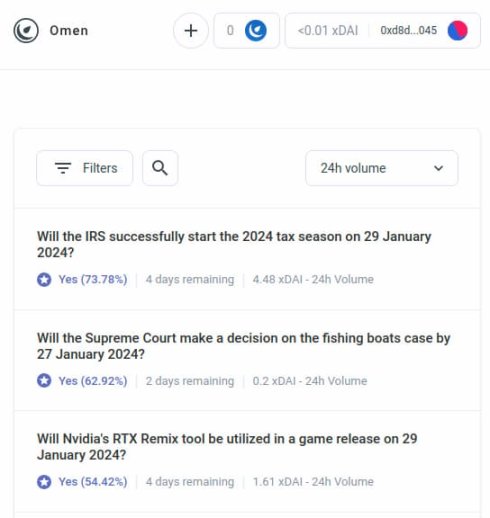

しかし、AI アービトラージボットは、より大きなカテゴリーの最初の例に過ぎず、私はすぐに他の多くのアプリケーションが含まれると予測しています。AI を参加者として利用した予測市場のデモである AIOmen を見てみましょう:

予測市場は長い間、認知技術の聖杯とされてきました。2014 年には、予測市場をガバナンスの入力(未来の支配)として使用することに興奮し、最近の選挙で広く試みました。しかし、これまでのところ、予測市場は実践においてあまり進展を遂げていません。その理由は多岐にわたります。最大の参加者はしばしば非合理的であり、正しい認識を持つ人々は多くの人が金銭に関与しない限り、時間をかけて賭けることを望まないため、市場は通常十分に活発ではありません。

これに対する一つの反応は、Polymarket や他の新しい予測市場が進行中のユーザーエクスペリエンスの改善を指摘し、以前の反復の失敗を克服し、成功を収めることを期待することです。人々はスポーツに数十億ドルを賭けることができるのに、なぜアメリカの選挙や LK99 に十分なお金を賭けないのでしょうか?真剣なプレイヤーが参加するようになるのでしょうか?しかし、この議論は、以前のバージョンがこの規模に達しなかったという事実に直面しなければなりません(少なくともその支持者の夢と比較して)。したがって、予測市場が成功するためには新しい要素が必要であるようです。したがって、別の反応は、2020 年代に期待される予測市場エコシステムの特定の特徴を指摘することです。2010 年代には見られなかった AI の広範な参加の可能性です。

AI は、1 時間あたり 1 ドル未満で働くことができ、百科事典のような知識を持っています。これが不十分であれば、リアルタイムのネットワーク検索機能と統合することさえできます。市場を作成し、50 ドルの流動性補助金を提供すれば、人間は入札を気にせず、何千もの AI が押し寄せ、彼らができる最良の推測を行うでしょう。

どんな問題でもうまく機能する動機は小さいかもしれませんが、良い予測を行う AI を作成する動機は数百万に上るかもしれません。注意すべきは、ほとんどの問題を裁定するために人間が必要ないことです。Augur や Kleros のような多段階の争議システムを使用することができ、AI も初期のラウンドに参加します。人間は、いくつかのアップグレードが発生し、両者が多額の資金を投入した場合にのみ反応する必要があります。

これは強力な原語です。なぜなら、「予測市場」をこのような微視的な規模で機能させることができれば、「予測市場」の原語を他の多くのタイプの問題に繰り返し適用できるからです。例えば:

- 使用規約に従って、このソーシャルメディアの投稿は受け入れられますか?

- 株式 X の価格はどう変化しますか(例えば、Numerai を参照)

- 現在メッセージを送信しているこのアカウントは本当にイーロン・マスクですか?

- オンラインタスク市場に提出されたこの仕事は受け入れられますか?

- https://examplefinance.network の DApp は詐欺ですか?

- 0x1b54….98c3 は「Casinu In」ERC20 トークンのアドレスですか?

あなたは気づくかもしれませんが、これらのアイデアの多くは、私が以前に言及した「情報防御」(info defense)の方向に向かっています。広義には、問題は次のようになります:私たちはどのようにしてユーザーが真偽情報を区別し、詐欺を認識するのを助けることができるでしょうか?中央集権的な権威に善悪を決定する権限を与えずに、その権力を悪用されないようにするにはどうすればよいのでしょうか?微視的なレベルでは、答えは「AI」かもしれません。

しかし、マクロ的なレベルでは、問題は次のようになります:誰が AI を構築したのか?AI はその創造プロセスの反映であり、したがって偏見が避けられません。異なる AI のパフォーマンスを判断するために、より高いレベルのゲームが必要であり、AI がプレイヤーとしてゲームに参加できるようにする必要があります。

このように AI を使用する方法は、AI がメカニズムに参加し、最終的に人間からの報酬を得たり罰を受けたりする(確率的な方法で)仕組みを持つことが非常に研究に値すると私は考えています。今こそ、このようなユースケースをより深く研究する適切な時期です。なぜなら、ブロックチェーンのスケーラビリティがついに成功を収め、以前はオンチェーンで実現できなかった「微視的」なあらゆる事柄が現在は実行可能になったからです。

関連するアプリケーションの一部は、高度に自律的なエージェントの方向に進化しており、支払いを通じて、またはスマートコントラクトを使用して信頼できる約束を行うためにブロックチェーンを使用しています。

AI をゲームのインターフェースとして

私が「My techno-optimism」で提案したアイデアの一つは、ユーザー向けのソフトウェアを作成する市場機会が存在し、ユーザーがオンライン世界で遭遇する危険を説明し、認識することでユーザーの利益を守ることができるというものです。MetaMask の詐欺検出機能は、すでに存在する例です。

もう一つの例は、Rabby ウォレットのシミュレーション機能で、ユーザーに署名しようとしている取引の予想結果を示します。

これらのツールは AI によって強化される可能性があります。AI は、あなたが参加している DApp がどのようなものであるか、あなたが署名しているより複雑な操作の結果、特定のトークンが本物であるか(例えば、BITCOIN は単なる文字列ではなく、実際の暗号通貨の名前であり、ERC20 トークンではなく、その価格は 0.045 ドルを大きく上回ります)などを説明する、より豊かで人間の理解に合った説明を提供できます。この方向に全力で進んでいるプロジェクトもいくつかあります(例えば、AI を主要なインターフェースとして使用する LangChain ウォレット)。私個人の見解は、現在の純粋な AI インターフェースはリスクが大きすぎる可能性があるため、他のタイプのエラーのリスクを増加させますが、AI とより伝統的なインターフェースを組み合わせることは非常に実行可能になっています。

特に言及すべきリスクがあります。私は下記の「AI をゲームのルールとして」部分でこれについて詳しく説明しますが、全体的な問題は対抗的機械学習です。もしユーザーがオープンソースのウォレット内に AI アシスタントを持っている場合、悪意のある者もその AI アシスタントにアクセスする機会を持つことになります。したがって、彼らはそのウォレットの防御を回避するために詐欺行為を最適化する無限の機会を持つことになります。すべての現代の AI には特定の脆弱性があり、モデルへのアクセスが限られているトレーニングプロセスでも、これらの脆弱性を見つけるのは容易です。

特に言及すべきリスクがあります。私は下記の「AI をゲームのルールとして」部分でこれについて詳しく説明しますが、一般的な問題は対抗的機械学習です。もしユーザーがオープンソースのウォレット内に AI アシスタントを持っている場合、悪意のある者もその AI アシスタントにアクセスする機会を持つことになります。したがって、彼らはそのウォレットの防御を回避するために詐欺行為を最適化する無限の機会を持つことになります。すべての現代の AI には特定の脆弱性があり、モデルへのアクセスが限られているトレーニングプロセスでも、これらの脆弱性を見つけるのは容易です。

これが「AI がオンチェーンのミニ市場に参加する」効果がより良い理由です。各 AI は同じリスクに直面しますが、意図的に数十人が継続的に反復し改善するオープンエコシステムを作成します。

さらに、各 AI は閉じられています。システムの安全性は、ゲームルールのオープン性から来ており、各参加者の内部動作からは来ていません。

要約すると、AI はユーザーが発生していることを簡単な言葉で理解するのを助け、リアルタイムのメンターとして機能し、ユーザーを誤った影響から守ることができますが、悪意のある誤導者や詐欺師に直面したときには注意が必要です。

AI をゲームのルールとして

さて、多くの人々が興奮しているアプリケーションについて議論しましょうが、私はこれが最もリスクが高いと考えており、非常に慎重に行動する必要があります。私が言う「AI がゲームのルールの一部」であることです。これは、主流の政治エリートが「AI 裁判官」に興奮していることに関連しています(例えば、「世界政府サミット」ウェブサイトで関連する記事を見ることができます)。ブロックチェーンアプリケーションにもこれらの願望の類似点があります。もしブロックチェーンベースのスマートコントラクトや DAO が主観的な決定を下す必要がある場合、AI を契約や DAO の一部として簡単に組み込んでこれらのルールを実行することができるでしょうか?

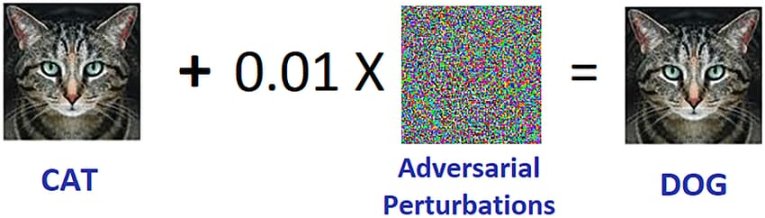

ここが対抗的機械学習が極めて困難な挑戦となる理由です。以下は簡単な論点です:

メカニズムの中で重要な役割を果たす AI モデルが閉じられている場合、その内部動作を検証することはできず、したがってそれは中央集権的なアプリケーションよりも優れているとは言えません。

AI モデルがオープンである場合、攻撃者はそれをローカルでダウンロードしてシミュレートし、高度に最適化された攻撃を設計してモデルを欺くことができ、その後、リアルタイムネットワーク上でそのモデルを再生することができます。

対抗的機械学習の例。出典:researchgate.net

さて、このブログを頻繁に読んでいる読者(あるいは暗号ネイティブの住民)は、私の意図を理解し始めているかもしれません。しかし、少々お待ちください。

私たちは先進的なゼロ知識証明や他の非常にクールな暗号学の形式を持っています。私たちは確かにいくつかの暗号魔法を行い、攻撃者が攻撃を最適化できないようにモデルの内部動作を隠しつつ、モデルが正しく実行されていることを証明し、合理的なトレーニングプロセスに基づいて合理的な基礎データセット上で構築されていることを証明することができるはずです。

通常、これは私がこのブログや他の文章で提唱している思考方法です。しかし、AI 計算に関しては、2 つの主要な異議があります:

- 暗号学的オーバーヘッド:SNARK(または MPC など)でタスクを実行することは、平文で実行するよりもはるかに効率が悪いです。AI 自体がすでに非常に高い計算要求を持っていることを考えると、暗号学的ブラックボックス内で AI 計算を実行することは計算的に実行可能でしょうか?

- ブラックボックス対抗的機械学習攻撃:モデルの内部動作を理解していなくても、AI モデルに対して攻撃を最適化する方法があります。隠蔽が過度に厳重である場合、トレーニングデータを選択する人が中毒攻撃を通じてモデルの整合性を損なうことが容易になるかもしれません。

これらの2つは、個別に深く探求する必要のある複雑なウサギの穴です。

暗号学的オーバーヘッド

暗号学的ツール、特に ZK-SNARK や MPC などの汎用ツールは、オーバーヘッドが非常に高いです。クライアントが直接イーサリアムブロックを検証するには数百ミリ秒かかりますが、そのようなブロックの正しさを証明するために ZK-SNARK を生成するには数時間かかることがあります。他の暗号ツール(例えば MPC)のオーバーヘッドはさらに大きいかもしれません。

AI 計算自体はすでに非常に高価です。最も強力な言語モデルは単語を出力する速度が人間の読書速度よりわずかに速いだけであり、これらのモデルのトレーニングには通常数百万ドルの計算コストがかかります。トップモデルと、トレーニングコストやパラメータ数をより節約しようとするモデルとの間には大きな品質差があります。一見すると、AI を暗号学で包むことで保証を追加するという全体のプロジェクトに対する疑念の良い理由となります。

しかし幸運なことに、AI は非常に特殊な計算タイプであり、さまざまな最適化を行うことができるため、ZK-EVM などのより「非構造化」計算タイプはこれから利益を得ることができません。AI モデルの基本構造を見てみましょう:

通常、AI モデルは主に一連の行列の乗算で構成されており、その中に各要素の非線形演算(例えば ReLU 関数 ( y = max(x, 0) ))が散在しています。漸近的には、行列の乗算が大部分の作業を占めます。これは暗号学にとって非常に便利です。なぜなら、多くの暗号形式は、行列の乗算を(少なくとも入力ではなく暗号モデルで)ほぼ「無料」で実行できるからです。

もしあなたが暗号学者であれば、同様の現象が同態暗号において知られていることを聞いたことがあるかもしれません。暗号化された密文に対して加算を実行するのは非常に簡単ですが、乗算は非常に困難であり、2009 年まで無限の深さで乗算操作を行う方法を見つけることはできませんでした。

ZK-SNARK に関しては、2013 年のプロトコルに類似しており、行列の乗算を証明する際のオーバーヘッドは 4 倍未満です。不幸なことに、非線形層のオーバーヘッドは依然として大きく、実践での最良の実装ではオーバーヘッドが約 200 倍であることが示されています。

しかし、さらなる研究を通じて、このオーバーヘッドを大幅に削減できる可能性があります。Ryan Cao のデモを参照してください。そこでは GKR に基づく最新の方法が紹介されており、私自身の GKR の主要な構成要素に関する簡略化された説明もあります。

しかし、多くのアプリケーションでは、AI の出力計算が正しいことを証明するだけでなく、モデルを隠すことも望まれます。これにはいくつかの簡単な方法があります。モデルを分割して、異なるサーバーのグループが各層を冗長的に保存し、特定のサーバーが特定の層のデータを漏洩しないことを期待することができます。しかし、驚くべき特別なマルチパーティ計算もあります。

この2つのケースにおいて、物語の教訓は同じです。AI 計算の主要な部分は行列の乗算であり、行列の乗算に対して非常に効率的な ZK-SNARK や MPC(さらには FHE)を設計できるため、AI を暗号学的フレームワークに組み込む総オーバーヘッドは予想外に低いです。通常、非線形層が最大のボトルネックですが、それらのサイズは小さいです。おそらく、パラメータの検索(lookup)などの新しい技術が助けになるかもしれません。

ブラックボックス対抗的機械学習

さて、もう一つの重要な問題について議論しましょう。モデルの内容が秘密に保たれている場合でも、「API アクセス」を通じてモデルにアクセスできる場合、依然として行える攻撃の種類があります。2016 年の論文を引用します:

多くの機械学習モデルは対抗的な例に対して脆弱です。特別に設計された入力が機械学習モデルに不正確な出力をもたらすことがあります。あるモデルに影響を与える対抗的な例は、異なるアーキテクチャや異なるトレーニングセットでトレーニングされた別のモデルにも影響を与えることがあり、両方のモデルが同じタスクを実行するためにトレーニングされている限りです。したがって、攻撃者は自分の代替モデルをトレーニングし、代替モデルに対して対抗的な例を作成し、それを被害者モデルに転送することができます。

潜在的には、攻撃対象のモデルへのアクセスが非常に制限されているか、アクセスできない場合でも、トレーニングデータを通じて攻撃を作成できるかもしれません。2023 年現在、この種の攻撃は依然として重大な問題です。

このようなブラックボックス攻撃を効果的に抑制するためには、次の2つのことを行う必要があります:

誰がモデルを照会できるか、または何が照会できるか、照会の数を真剣に制限すること。無制限の API アクセスを持つブラックボックスは安全ではありません。非常に制限された API アクセスを持つブラックボックスは安全である可能性があります。

トレーニングデータを隠しつつ、トレーニングデータ作成プロセスが損なわれないようにすることが重要な目標です。

前者に関しては、この分野で最も多くのことを行っているプロジェクトはおそらく Worldcoin です。私はここでその初期バージョン(および他のプロトコル)について詳しく分析しました。Worldcoin はプロトコルレベルで広範に AI モデルを使用しており、(i)虹彩スキャンを比較可能な短い「虹彩コード」に変換し、(ii)スキャンされた物体が実際に人間であることを検証します。

Worldcoin が依存している主要な防御策は、誰も AI モデルを簡単に呼び出すことを許可しないことです。代わりに、信頼できるハードウェアを使用して、そのモデルが orb カメラによってデジタル署名された入力のみを受け入れることを保証します。

このアプローチは効果的であることを保証するものではありません。物理的なパッチや顔に装着された宝飾品などを通じて生体認証 AI に対して対抗的な攻撃を行うことができることが判明しています。

額に追加のものを装着することで、検出を回避したり他の人になりすますことができます。出典:https://arxiv.org/pdf/2109.09320.pdf

しかし、私たちの希望は、すべての防御策を統合し、AI モデル自体を隠し、照会の数を厳しく制限し、各照会が何らかの方法で認証されることを要求すれば、対抗的な攻撃が非常に困難になり、システムがより安全になることです。

これが次の問題を引き起こします。私たちはトレーニングデータをどのように隠すことができるでしょうか?これが「DAO によって民主的に管理された AI」が実際に意味を持つ可能性がある理由です。私たちは、誰がトレーニングデータを提出できるか(およびデータ自体に必要な声明)、誰が照会できるか、照会の数を管理するためのオンチェーン DAO を作成し、MPC のような暗号技術を使用して、各個人ユーザーのトレーニング入力から各照会の最終出力までの AI の作成と実行プロセス全体を暗号化することができます。この DAO は、データを提出する人々に報酬を与えるという広く受け入れられている目標を同時に満たすことができます。

この計画は非常に野心的であり、多くの面で非現実的であることを証明する可能性があることを再度強調する必要があります:

- この完全なブラックボックスアーキテクチャに対して、暗号学的オーバーヘッドは依然として高すぎる可能性があり、従来の閉じた「信じてください」アプローチと競争できないかもしれません。

- 実際には、トレーニングデータ提出プロセスを分散化し、中毒攻撃を防ぐ良い方法はないかもしれません。

- 参加者が共謀することにより、マルチパーティ計算デバイスがそのセキュリティまたはプライバシー保証を損なう可能性があります。結局のところ、この状況はクロスチェーンブリッジで繰り返し発生しています。

私がこのセクションの冒頭で「AI 裁判官を作るな、それはディストピアだ」と警告しなかった理由の一つは、私たちの社会がすでに説明責任のない中央集権的な AI 裁判官に高度に依存しているからです。ソーシャルメディア上でどのタイプのアルゴリズムの投稿や政治的見解が昇進または低下し、さらには検閲されるかを決定します。

私は、現在の段階でこの傾向をさらに拡大することはかなり悪いアイデアだと考えていますが、暗号コミュニティが AI に対してさらに実験を行うことが状況を悪化させる主な理由になるとは思いません。

実際、暗号技術には、既存の中央集権的システムを改善する非常に基本的で低リスクの方法がいくつかあり、私はこれに非常に自信を持っています。単純な技術の一つは、遅延公開の検証 AI です。ソーシャルメディアサイトが AI ベースの投稿ランキングを使用する場合、そのモデルのハッシュ値を生成したことを証明する ZK-SNARK を公開できます。そのサイトは、一定の遅延後(例えば1年)にその AI モデルを公開することを約束できます。

モデルが公開されると、ユーザーはハッシュ値を確認して正しいモデルが公開されたかどうかを検証でき、コミュニティはモデルをテストしてその公平性を確認できます。公開の遅延は、モデルが公開されるときにはすでに時代遅れになっていることを保証します。

したがって、中央集権的な世界と比較して、問題は私たちがどれだけ良くできるかではなく、私たちがどれだけ良くできるかということです。しかし、分散型の世界では慎重に行動する必要があります。誰かが AI オラクルを使用した予測市場やステーブルコインを構築し、その後誰かがオラクルが攻撃可能であることを発見した場合、大量の資金が瞬時に消失する可能性があります。

AI をゲームの目標として

もし上記の技術が実際に機能し、スケーラブルな分散型プライベート AI(その内容が誰にも知られていないブラックボックス)を作成することができるなら、これはブロックチェーンを超える実用性を持つ AI を作成するためにも使用できます。NEAR プロトコルチームは、これを彼らの進行中の作業の核心目標として位置付けています。

これには2つの理由があります:

- ブロックチェーンとマルチパーティ計算の何らかの組み合わせを使用してトレーニングと推論プロセスを実行することで、「信頼できるブラックボックス AI」を作成できれば、システムに偏見や詐欺が存在することを心配している多くのユーザーが恩恵を受けることができます。多くの人々が私たちが依存している AI の民主的なガバナンスを望んでおり、暗号学とブロックチェーンベースの技術がこの目標を達成する手段となるかもしれません。

AI の安全性の観点から見れば、これは自然な緊急停止スイッチを持ちながら、悪意のある行動を試みる照会を制限できる分散型 AI を作成する技術となります。

注目すべきは、「より良い AI を作成するためのインセンティブを暗号学的に使用する」ことが、暗号学を完全に使用するウサギの穴に完全に陥ることなく実現できるということです。BitTensor のようなアプローチがこのカテゴリーに属します。

結論

ブロックチェーンと AI の進化に伴い、両者の交差領域におけるアプリケーションケースも増加しています。その中には、より意味のある、より堅牢なユースケースもあります。

全体的に見て、基盤となるメカニズムが基本的に設計を維持しつつ、個々の参加者が AI となるアプリケーションケースは、より微視的なレベルで効果的に機能するメカニズムであり、最も即時の展望を持ち、実現が容易です。

最も挑戦的なのは、ブロックチェーンと暗号学技術を使用して「単一の」アプリケーションを作成しようとするものです。特定のアプリケーションが何らかの目的のために依存する単一の分散型信頼できる AI です。

これらのアプリケーションは、機能性と AI の安全性を改善する可能性を持ちながら、中央集権的なリスクを回避します。

しかし、基盤となる仮定は多くの面で失敗する可能性があります。したがって、特に高価値で高リスクな環境でこれらのアプリケーションを展開する際には慎重に行動する必要があります。

私は、これらのすべての分野でより建設的な AI アプリケーションケースの試みを見たいと期待しています。そうすれば、どのユースケースがスケールで本当に実行可能であるかを見極めることができるでしょう。