Vitalik Buterin:Crypto+AI 應用前景和挑戰

撰文:Vitalik Buterin

編譯:Karen,Foresight News

特別感謝 Worldcoin 和 Modulus Labs 團隊、Xinyuan Sun、Martin Koeppelmann 和 Illia Polosukhin 的反饋和討論。

多年以來,很多人問過我這樣一個問題:「加密貨幣和 AI 之間最富有成效的交叉點在哪裡?」這是一個合理的問題:加密貨幣和 AI 是過去十年中兩個主要的深度(軟體)技術趨勢,兩者之間必定存在某種聯繫。

從表面上看,很容易找到兩者的協同作用:加密貨幣的去中心化可以平衡 AI 中心化,AI 是不透明的,而加密貨幣可以帶來透明度;AI 需要數據,而區塊鏈擅長存儲和追蹤數據。但多年來,當大家要求我深入探討具體應用時,我的回答一直比較令人失望:「是的,確實有一些值得探討的應用,但並不多」。

在過去的三年裡,隨著現代 LLM(大型語言模型)等更強大的 AI 技術的興起,以及不僅僅是區塊鏈擴容解決方案,還有零知識證明、全同態加密、(兩方和多方)安全多方計算等更強大加密貨幣技術的興起,我開始看到了這種變化。在區塊鏈生態系統內,或者將 AI 與密碼學結合起來,確實存在一些有前景的 AI 應用,儘管在應用 AI 時需要小心謹慎。一個特殊的挑戰是:在密碼學中,開源是使某些東西真正安全的唯一方法,但在 AI 中,開放的模型(甚至其訓練數據)大大增加了其對抗性機器學習攻擊的脆弱性。這篇文章將對 Crypto+AI 可能交叉的不同方式進行分類,並探討每個分類的前景和挑戰。

來自 uETH 博客文章的 Crypto+AI 交叉點的總結。但如何才能在具體應用中真正實現這些協同作用呢?

Crypto+AI 四大交叉點

AI 是一個非常廣泛的概念:你可以將 AI 視為一組算法,你創建的算法不是通過明確指定,而是通過搅拌一個大的計算湯(computational soup)並施加某種優化壓力來推動湯生成具有你想要的屬性的算法。

這個描述絕對不應該被輕視,因為它包括了創造我們人類的過程!但這也意味著 AI 算法具有一些共同的特徵:它們具有非常強大的能力,同時我們在了解或理解其內部運行過程上存在一定的限制。

有許多方法可以對人工智能進行分類,針對本文所討論的人工智能與區塊鏈之間的相互作用(Virgil Griffith 《字面意思來看,以太坊是一種變革遊戲規則的技術》文章),我將按以下方式對其進行分類:

AI 作為遊戲中的參與者(最高的可行性):在 AI 參與的機制中,激勵的最終來源來自於人類輸入的協議。

AI 作為遊戲界面(潛力很大,但存在風險):AI 幫助用戶理解周圍的加密世界,並確保他們的行為(例如簽名的消息和交易)與其意圖相符,以避免被欺騙或受騙。

AI 作為遊戲規則(需要非常謹慎):區塊鏈、DAO 和類似機制直接調用 AI。例如,「AI 法官」。

AI 作為遊戲目標(長期而有趣):設計區塊鏈、DAO 和類似機制的目標是構建和維護一個可以用於其他目的的 AI,使用加密技術的部分要麼是為了更好地激勵訓練,要麼是為了防止 AI 泄露私人數據或被濫用。

讓我們一一回顧一下。

AI 作為遊戲參與者

實際上,這個類別已經存在了將近十年,至少從鏈上去中心化交易所(DEX)開始被廣泛使用以來就存在了。每當存在交易所時,就有通過套利賺錢的機會,而機器人可以比人類更好地進行套利。

這種用例已經存在了很長時間,即使使用的是比現在簡單得多的 AI,但最終它確實是 AI 和加密貨幣的真實交叉點。最近,我們經常看到 MEV(最大化可提取價值)套利機器人相互利用。任何時候涉及拍賣或交易的區塊鏈應用都會存在套利機器人。

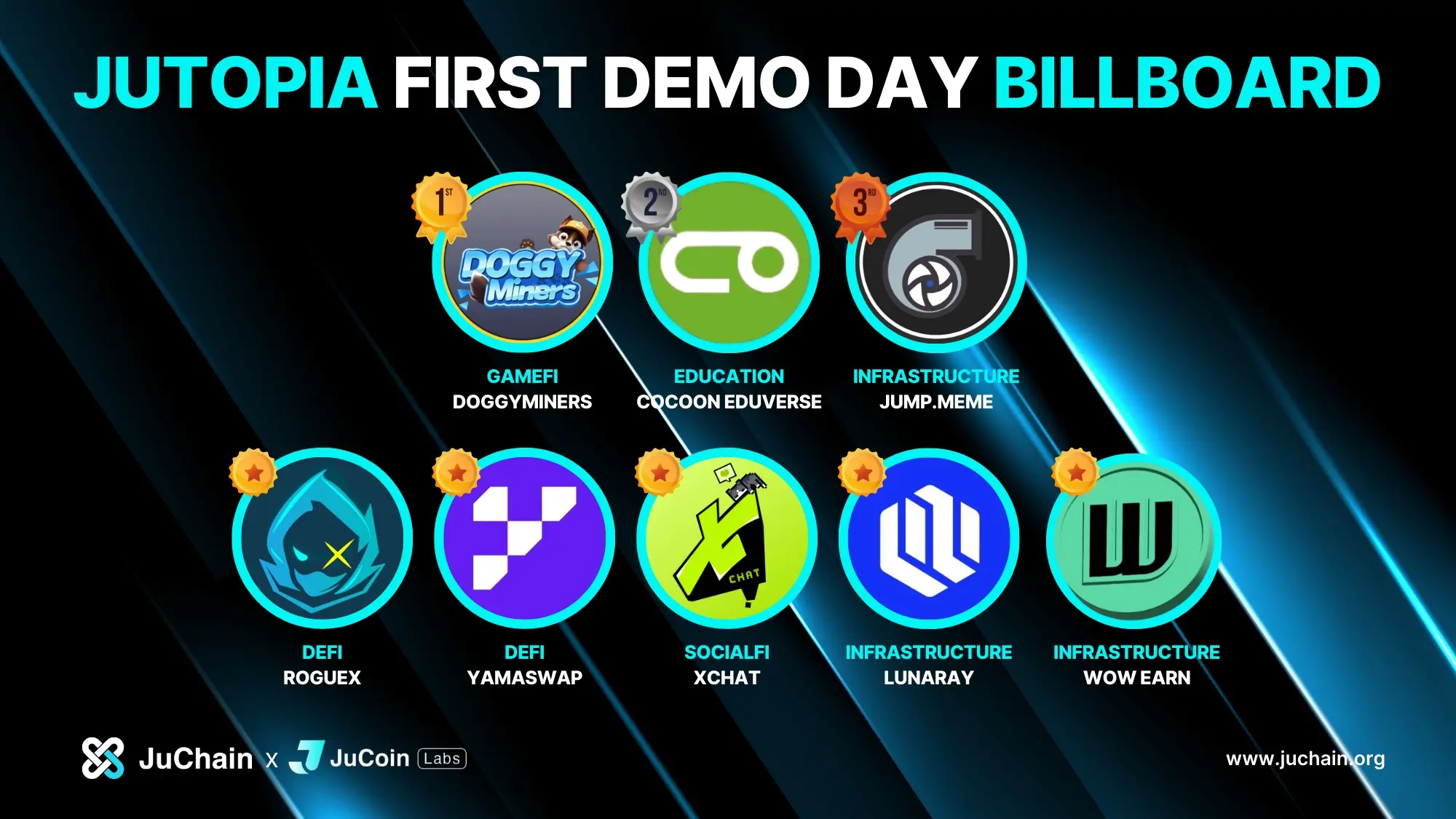

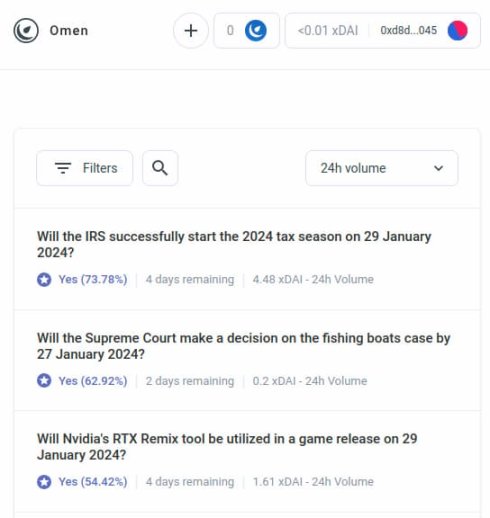

但是,AI 套利機器人只是更大類別的第一個例子,我預計很快將會涵蓋許多其他應用。讓我們來看看 AIOmen,一個 AI 作為參與者的預測市場的演示:

預測市場長期以來一直是認知技術的聖杯。早在 2014 年,我就對將預測市場用作治理的輸入(未來統治)感到興奮,並在最近的 election 中廣泛嘗試過。但迄今為止,預測市場在實踐中並沒有取得太大進展,原因有很多:最大的參與者往往是非理性的,擁有正確認知的人不願意花時間和下注,除非有很多人涉及金錢、市場通常不夠活躍等等。

對此的一種回應是指出 Polymarket 或其他新的預測市場正在進行的用戶體驗改進,並希望它們能夠在之前的迭代失敗的地方不斷完善並取得成功。人們願意在體育上押注數百億美元,那麼為什麼人們不投入足夠的錢投注美國大選或 LK99,讓認真的玩家開始參與進來呢?但這個論點必須面對一個事實,即之前的版本未能達到這種規模(至少與其支持者的夢想相比),因此似乎需要一些新的元素才能使預測市場取得成功。因此,另一個回應是指出預測市場生態系統的一個特定特點,在 2020 年代我們可以期待看到,而在 2010 年代我們沒有看到:AI 的廣泛參與可能性。

AI 願意或者可以以每小時不到 1 美元的價格工作,並具有百科全書般的知識。如果這還不夠,它們甚至可以與實時網絡搜索功能集成。如果你創建一個市場,並提供 50 美元的流動性補貼,人類不會關心出價,但成千上萬的 AI 會很容蜂擁而至,並做出他們能做出的最佳猜測。

在任何一個問題上做好工作的動機可能很小,但製造出能夠做出良好預測的 AI 的動機可能是數以百萬計的。請注意,您甚至不需要人類來裁決大多數問題:您可以使用類似於 Augur 或 Kleros 的多輪爭議系統,其中 AI 也將參與早期輪次。人類只需要在發生一系列升級並且雙方都投入了大量資金的少數情況下做出反應。

這是一個強大的原語,因為一旦可以使「預測市場」在如此微觀的規模上發揮作用,您就可以將「預測市場」原語重複用於許多其他類型的問題,比如:

根據[使用條款],此社交媒體帖子是否可以接受?

股票 X 的價格會發生什麼變化(例如,參見 Numerai)

目前給我發消息的這個賬戶真的是埃隆·馬斯克嗎?

在在線任務市場上提交的這項工作可以接受嗎?

https://examplefinance.network 上的 DApp 是騙局嗎?

0x1b54….98c3 是「Casinu In」ERC20 代幣地址嗎?

你可能會注意到,其中很多想法都朝著我在先前提到的「信息防禦」(info defense)的方向發展。廣義上來說,問題是:我們如何幫助用戶區分真假信息和識別欺詐行為,而不給予一個中心化的權威機構決定是非對錯的權力,以免其濫用這個權力?在微觀層面上,答案可以是「AI」。

但從宏觀層面來看,問題是:誰構建了 AI?AI 是其創造過程的反映,因此不可避免地存在偏見。需要一種更高級別的遊戲來判斷不同 AI 的表現,讓 AI 可以作為玩家參與遊戲。

這種使用 AI 的方式,其中 AI 參與到一個機制中,最終通過一個鏈上機制從人類那裡獲得獎勵或受到懲罰(以概率方式),我認為這是非常值得研究的。現在是更深入研究這樣的用例的合適時機,因為區塊鏈的擴展性終於取得了成功,使得以前往往無法在鏈上實現的「微觀」任何事物現在可能可行。

相關的一類應用程序正朝著高度自治的代理方向發展,使用區塊鏈來更好地合作,無論是通過支付還是通過使用智能合約做出可信的承諾。

AI 作為遊戲界面

我在《My techno-optimism》中提出的一個想法是,編寫面向用戶的軟體存在市場機會,該軟體可以通過解釋和識別用戶正在瀏覽的在線世界中的危險來保護用戶的利益。MetaMask 的詐騙檢測功能就是一個已經存在的例子。

另一個例子是 Rabby 錢包的模擬功能,它向用戶展示他們即將簽署的交易的預期結果。

這些工具有可能被 AI 增強。AI 可以給出更豐富、更符合人類理解的解釋,解釋你參與的 DApp 是什麼樣的,你正在簽署的更複雜操作的後果,特定代幣是否真實(例如,BITCOIN 不僅僅是一串字符,它是一個真實的加密貨幣的名稱,它不是一個 ERC20 代幣,其價格遠遠高於 0.045 美元)等等。有一些項目開始朝這個方向全力發展(例如,使用 AI 作為主要界面的 LangChain 錢包)。我個人的觀點是,目前純粹的 AI 界面可能存在風險太大,因為它增加了其他類型錯誤的風險,但是 AI 與更傳統的界面相結合變得非常可行。

有一個值得提及的特定風險。我將在下面關於「AI 作為遊戲規則」部分更詳細地介紹這一點,但總體問題是對抗性機器學習:如果用戶在開源錢包內有一個 AI 助手,那麼壞人也會有機會獲得那個 AI 助手,因此他們將有無限的機會優化他們的欺詐行為,以避開該錢包的防禦措施。所有現代 AI 都會有某些漏洞,而即使只有對模型有限訪問權限的訓練過程,也很容易找到這些漏洞。

有一個特別的風險值得一提。我將在下面的「AI 作為遊戲規則」部分詳細討論這一點,但一般問題是對抗性機器學習:如果用戶可以訪問開源錢包內的 AI 助手,那麼壞人就會有也可以訪問該 AI 助手,因此他們將有無限的機會優化他們的騙局,以免觸發該錢包的防禦。所有現代 AI 都在某個地方存在錯誤,並且對於訓練過程來說,即使是對模型的訪問權限有限的訓練過程,找到它們也不是太難。

這就是「AI 參與鏈上微型市場」效果更好的地方:每個單獨的 AI 都面臨相同的風險,但你有意創建一個由數十人不斷迭代和改進的開放生態系統。

此外,每個單獨的 AI 都是封閉的:系統的安全性來自於遊戲規則的開放性,而不是每個參與者的內部運作。

總結:AI 可以幫助用戶用簡單的語言理解正在發生的事情,可以充當實時導師,保護用戶免受錯誤的影響,但在遇到惡意誤導者和詐騙者時要注意。

AI 作為遊戲規則

現在,我們來討論許多人都感到興奮的應用,但我認為這是最具風險的,並且我們需要極其謹慎地行動:我所說的 AI 是遊戲規則的一部分。這與主流政治精英對「AI 法官」的興奮有關(例如,可以在「世界政府峰會」網站上看到相關文章),並且在區塊鏈應用中也存在這些願望的類似情況。如果一個基於區塊鏈的智能合約或 DAO 需要做出主觀決策,你能讓 AI 簡單地成為合約或 DAO 的一部分來幫助執行這些規則嗎?

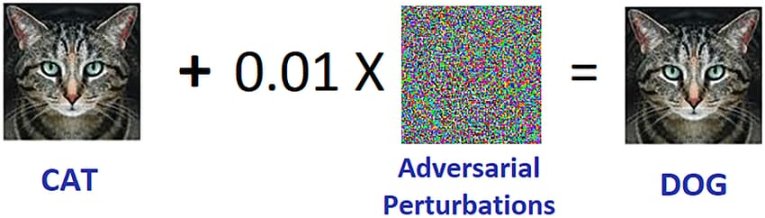

這就是對抗性機器學習將是一个極其艱巨的挑戰的地方。以下是一個簡單的論點:

如果一個在機制中起關鍵作用的 AI 模型是封閉的,你就無法驗證它的內部運作,所以它並不比中心化應用更好。

如果 AI 模型是開放的,那麼攻擊者可以在本地下載並模擬它,並設計經過高度優化的攻擊來欺騙模型,然後他們可以在實時網絡上重放該模型。

對抗性機器學習示例。來源:researchgate.net

現在,經常閱讀本博客(或者是加密原生居民)的讀者可能已經領會到了我的意思,並開始思考。但請稍等。

我們擁有先進的零知識證明和其他非常酷的密碼學形式。我們肯定可以進行一些加密魔法,隱藏模型的內部運作,以便攻擊者無法優化攻擊,同時證明模型正在正確執行,並且是通過一個合理的訓練過程在合理的基礎數據集上構建的。

通常情況下,這正是我在這個博客和其他文章中提倡的思維方式。但是在涉及 AI 計算的情況下,存在兩個主要的異議:

密碼學開銷:在 SNARK(或 MPC 等)中執行某項任務比明文執行效率低得多。考慮到 AI 本身已經具有很高的計算需求,是否在密碼學黑匣子中執行 AI 計算在計算上是否可行?

黑匣子對抗性機器學習攻擊:即使不了解模型的內部工作原理,也有方法對 AI 模型進行攻擊優化。如果隱藏得過於嚴密,你可能會使選擇訓練數據的人更容易通過中毒攻擊來損害模型的完整性。

這兩個都是複雜的兔子洞,需要逐個進行深入探討。

加密開銷

密碼學工具,尤其是 ZK-SNARK 和 MPC 等通用工具,開銷很高。客戶端直接驗證以太坊區塊需要幾百毫秒,但生成 ZK-SNARK 來證明此類區塊的正確性可能需要數小時。其他加密工具(例如 MPC)的開銷可能更大。

AI 計算本身已經非常昂貴:最強大的語言模型輸出單詞的速度只比人類閱讀速度稍快一些,更不用說訓練這些模型通常需要數百萬美元的計算成本。頂級模型與試圖在訓練成本或參數數量上更加節省的模型之間的質量差異很大。乍一看,這是懷疑將 AI 包裹在密碼學中以添加保證的整個項目的一个很好的理由。

不過幸運的是,AI 是一種非常特殊的計算類型,這使得它能夠進行各種優化,而 ZK-EVM 等更多「非結構化」計算類型無法從中受益。讓我們來看看 AI 模型的基本結構:

通常,AI 模型主要由一系列矩陣乘法組成,其中散布著每個元素的非線性運算,例如 ReLU 函數 ( y = max(x, 0) )。漸近地,矩陣乘法佔據了大部分工作。這對於密碼學來說確實很方便,因為許多密碼學形式可以幾乎「免費」地進行線性操作(至少在加密模型而不是輸入時進行矩陣乘法運算)。

如果您是密碼學家,可能已經聽說過同態加密中的類似現象:對加密密文執行加法非常容易,但乘法卻非常困難,直到 2009 年我們才找到了一種無限深度的方法來進行乘法操作。

對於 ZK-SNARK,類似於 2013 年的協議,該協議在證明矩陣乘法方面的開銷不到 4 倍。不幸的是,非線性層的開銷仍然很大,實踐中最好的實現顯示開銷約為 200 倍。

但是,通過進一步的研究,有希望大大減少這種開銷。可以參考 Ryan Cao 的演示,其中介紹了一種基於 GKR 的最新方法,以及我自己對 GKR 主要組成部分的簡化解釋。

但對於許多應用程序來說,我們不僅想證明 AI 輸出計算正確,還想隱藏模型。對此有一些簡單的方法:您可以拆分模型,以便一組不同的伺服器冗餘地存儲每個層,並希望洩漏某些層的某些伺服器不會洩漏太多數據。但也有一些令人驚訝的專門多方計算。

在這兩種情況下,故事的寓意是相同的:AI 計算的主要部分是矩陣乘法,而針對矩陣乘法可以設計非常高效的 ZK-SNARKs、MPCs(甚至是 FHE),因此將 AI 放入密碼學框架中的總開銷出乎意料地很低。通常情況下,非線性層是最大的瓶頸,儘管它們的大小較小。也許像查找參數(lookup)等新技術可以提供幫助。

黑盒對抗性機器學習

現在,讓我們來討論另一個重要問題:即使模型的內容保持私密,你只能通過「API 訪問」模型,你仍然可以進行的攻擊類型。引用一篇 2016 年的論文:

許多機器學習模型容易受到對抗性示例的影響:專門設計的輸入會導致機器學習模型產生不正確的輸出。影響一個模型的對抗性示例通常會影響另一個模型,即使這兩個模型具有不同的架構或在不同的訓練集上進行訓練,只要兩個模型都經過訓練以執行相同的任務即可。因此,攻擊者可以訓練自己的替代模型,針對替代模型製作對抗性示例,並將其轉移到受害者模型,而有關受害者的信息很少。

潛在地,即使你對要攻擊的模型的訪問非常有限或沒有訪問權限,你甚至可以僅僅通過訓練數據來創建攻擊。截至 2023 年,這類攻擊仍然是一個重大問題。

為了有效遏制此類黑盒攻擊,我們需要做兩件事:

真正限制誰或什麼可以查詢模型以及查詢的數量。具有無限制 API 訪問權限的黑盒是不安全的;具有非常受限的 API 訪問權限的黑盒可能是安全的。

隱藏訓練數據的同時,確保訓練數據創建過程的不被損壞是一個重要目標。

就前者而言,在這方面做得最多的項目可能是 Worldcoin,我在這裡詳細分析了它的早期版本(以及其他協議)。Worldcoin 在協議級別廣泛使用 AI 模型,以(i)將虹膜掃描轉換為易於比較相似性的簡短「虹膜代碼」,以及(ii)驗證其掃描的物體實際上是人類。

Worldcoin 所依賴的主要防禦措施是,不允許任何人簡單地調用 AI 模型:相反,它使用可信硬體來確保該模型只接受由 orb 相機數字簽名的輸入。

這種方法並不保證有效:事實證明,你可以通過物理貼片或佩戴在臉上的珠寶等方式對生物特徵識別 AI 進行對抗性攻擊。

在額頭上戴上額外的東西,可以規避檢測甚至冒充別人。來源:https://arxiv.org/pdf/2109.09320.pdf

但是我們的希望是,如果將所有防禦措施綜合起來,包括隱藏 AI 模型本身、嚴格限制查詢數量,並要求每個查詢以某種方式進行身份驗證,那麼對抗性攻擊就會變得非常困難,從而使系統更加安全。

這就引出了第二個問題:我們如何隱藏訓練數據?這就是「由 DAO 民主管理 AI」實際上可能有意義的地方:我們可以創建一個鏈上的 DAO,來管理允許誰提交訓練數據(以及對數據本身所需的陳述),誰可以進行查詢以及查詢的數量,並使用諸如 MPC 的密碼學技術來加密從每個個體用戶的訓練輸入到每個查詢的最終輸出的整個 AI 創建和運行流程。這個 DAO 可以同時滿足廣受歡迎的目標,即對提交數據的人進行補償。

需要重申的是,這個計劃是非常雄心勃勃的,並且有很多方面可以證明它是不切實際的:

對於這種完全黑盒架構來說,加密開銷仍然可能太高,無法與傳統的封閉式「trust me」方法競爭。

事實可能是,沒有一種好的方法可以使訓練數據提交過程去中心化並防止中毒攻擊。

由於參與者串通,多方計算設備可能會破壞其安全或隱私保證:畢竟,這種情況在跨鏈橋上一再發生過。

我沒有在本節開頭警告「不要做 AI 法官,那是反烏托邦」的原因之一是,我們的社會已經高度依賴於不可問責的集中式 AI 法官:決定哪種類型的算法帖子和政治觀點在社交媒體上得到提升和降低,甚至受到審查。

我確實認為,在當前階段進一步擴大這一趨勢是一個相當糟糕的想法,但我並不認為區塊鏈社區對 AI 進行更多的實驗會是使情況變得更糟糕的主要原因。

實際上,加密技術有一些非常基本且低風險的方式可以改進甚至是現有的集中式系統,我對此非常有信心。其中一種簡單的技術是延遲發布的驗證 AI:當社交媒體網站使用基於 AI 的帖子排名時,它可以發布一個 ZK-SNARK,證明生成該排名的模型的哈希值。該網站可以承諾在一定延遲後(例如一年)公開其 AI 模型。

一旦模型被公開,用戶可以檢查哈希值以驗證是否發布了正確的模型,並且社區可以對模型進行測試以驗證其公平性。發布延遲將確保模型發布時,它已經過時了。

因此,與中心化世界相比,問題不在於我們是否能夠做得更好,而在於我們能夠做到多好。然而,對於去中心化的世界來說,需要謹慎行事:如果有人構建了一個使用 AI 預言機的預測市場或穩定幣,然後有人發現預言機是可以攻擊的,那將有一大筆資金可能會在瞬間消失。

AI 作為遊戲目標

如果上述用於創建可擴展的去中心化私人 AI(其內容是不為任何人所知的黑匣子)的技術實際上可以發揮作用,那麼這也可以用於創建具有超越區塊鏈的實用性的 AI。NEAR 協議團隊正在將此作為他們正在進行的工作的核心目標。

這樣做有兩個原因:

如果通過使用區塊鏈和多方計算的某種組合來運行訓練和推斷過程,可以創建「可信任的黑匣子 AI」,那麼許多用戶擔心系統存在偏見或欺騙的應用程序可以從中受益。許多人表達了對我們所依賴的 AI 進行民主治理的願望;密碼學和基於區塊鏈的技術可能是實現這一目標的途徑。

從 AI 安全的角度來看,這將是一種創建去中心化 AI 的技術,同時具有自然的緊急停止開關,並且可以限制試圖使用 AI 進行惡意行為的查詢。

值得注意的是,「使用加密激勵來鼓勵製作更好的 AI」可以在不完全陷入使用密碼學完全加密的兔子洞的情況下實現:像 BitTensor 這樣的方法就屬於這個類別。

結論

隨著區塊鏈和 AI 的不斷發展,兩者交叉領域的應用案例也正在增加,其中一些用用例更具意義和更具魯棒性。

總體而言,那些底層機制基本保持設計不變,但個體參與者變成了 AI 的應用案例,在更微觀的層面上有效地運行的機制,是最具有即時前景和最容易實現的。

最具挑戰性的是那些試圖使用區塊鏈和密碼學技術創建「單例」(singleton)的應用程序:某些應用程序出於某種目的而依賴的單個去中心化可信 AI。

這些應用程序在功能性和改善 AI 安全性方面都具有潛力,同時避免中心化風險。

但底層假設也有可能在很多方面失效。因此,尤其是在高價值和高風險環境中部署這些應用程序時需要謹慎行事。

我期待在所有這些領域看到更多有建設性的 AI 應用案例的嘗試,這樣我們就可以看到哪些用例在規模上真正可行。