a16z:新しい時代の「ピクサー」、AIは映画とゲームをどのように融合させるのか?

原題:《The Next Generation Pixar: How AI will Merge Film \& Games》

著者:Jonathan Lai

翻訳:深潮TechFlow

過去の1世紀にわたり、技術革新は私たちのお気に入りの物語を数多く生み出してきました。1930年代を例に挙げると、ディズニーは多平面カメラを発明し、音声同期のフルカラーアニメーションを初めて制作しました。この技術のブレークスルーは、画期的なアニメ映画『白雪姫』の誕生を促しました。

1940年代には、マーベルとDCコミックスが台頭し、「コミックの黄金時代」と称されるようになりました。これは四色回転印刷機とオフセット印刷技術の広範な利用によるもので、漫画が大規模に印刷されるようになりました。この技術の限界、すなわち低解像度、限られた色調範囲、安価な新聞紙でのドット印刷は、今日でも認識できる象徴的な「パルプ」外観を形成しています。

同様に、ピクサーは1980年代に新しい技術プラットフォーム、すなわちコンピュータと3Dグラフィックスを利用する独自の立場にありました。共同創設者のエドウィン・キャットマルは、NYITコンピュータグラフィックス研究所とルーカスフィルムの初期研究者であり、基礎的なCGIコンセプトを開拓し、後に完全にコンピュータ生成されたアニメーション長編映画『トイ・ストーリー』を発表しました。ピクサーのグラフィックレンダリングスイートRendermanは、現在までに500本以上の映画に使用されています。

各技術の波の中で、最初は新奇なものとしての初期プロトタイプが、世代を超えた新しいクリエイターによって深い物語の新しいフォーマットへと進化していきます。今日、私たちは次のピクサーが誕生しようとしていると信じています。生成的人工知能( Generative AI )は、創造的な物語の根本的な変化を推進しており、新しい世代の人間のクリエイターが全く新しい方法で物語を語ることを可能にしています。

具体的には、私たちは次の世代のピクサーが従来の映画やアニメーションではなく、インタラクティブビデオを通じて誕生するだろうと考えています。この新しい物語のフォーマットは、ビデオゲームとテレビ/映画の境界を曖昧にし、深い物語と観客の能動性、そして「ゲーム」を融合させ、巨大な新しい市場を開くことになります。

ゲーム:現代の物語の最前線

現在、次世代の物語会社の形成を加速させる可能性のある2つの主要な波が存在します:

消費者がインタラクティブメディア(線形/受動的メディア、すなわちテレビ/映画ではなく)にシフトしていること

生成的人工知能による技術の進歩

過去30年間、私たちは消費者のシフトが深まるのを見てきました。ゲームとインタラクティブメディアは、各世代でますます人気を博しています。Z世代やそれ以下の世代にとって、ゲームは今や彼らが余暇を過ごす際の第一選択肢であり、テレビや映画を超えています。2019年、NetflixのCEOリード・ハスティングスは、株主への手紙の中で「私たちはFortniteとの競争をしており(しばしば負けています)、それはHBOを超えています」と述べました。ほとんどの家庭にとって、問題は「何を見ているか」ではなく「何を遊んでいるか」です。

テレビ、映画、書籍は依然として魅力的な物語を語っていますが、最も革新的で成功した新しい物語の多くは、今やゲームの中で語られています。例えば、『ハリー・ポッター』。オープンワールドRPG『ホグワーツの遺産』は、プレイヤーにホグワーツの新入生になる没入感を提供します。このゲームは2023年のベストセラーとなり、発売時の収入は10億ドルを超え、興行収入は最後の『ハリー・ポッター:死の秘宝(下)』を除くすべての『ハリー・ポッター』映画を超えました(10.3億ドル)。

ゲームの知的財産(IP)は、最近テレビや映画の適応でも大きな成功を収めています。ノーティドッグの『最後の生還者』は2023年にHBO Maxで最も視聴されたシリーズとなり、各エピソードで平均3200万人の視聴者を記録しました。『スーパーマリオブラザーズ』映画は14億ドルの興行収入を上げ、アニメ映画としては世界初の週末の最大のスタートを切りました。さらに、高評価を得た『フォールアウト』シリーズ、パラマウントの『ハロー』シリーズ、トム・ホランドの『トゥームレイダー』映画、マイケル・ベイの『Skibidi Toilet』映画など、数多くの成功例があります。

インタラクティブメディアが非常に強力な理由の一つは、積極的な参加が物語や宇宙に対する親密感を築くのに役立つからです。ゲームを1時間プレイすることの集中力は、テレビを1時間受動的に見ることをはるかに上回ります。多くのゲームは社交的でもあり、コアデザインにマルチプレイヤー機能が組み込まれています。最も記憶に残る物語は、しばしば私たちが友人や家族と共に創作し、共有するものです。

観客は複数のメディア(視聴、ゲーム、創作、共有)を通じて知的財産と継続的にインタラクションを持ち、物語は単なるエンターテインメントではなく、個人のアイデンティティの一部となります。ある人が単なる「『ハリー・ポッター』の観客」から「忠実なポッターヘッド」へと成長する際に起こる素晴らしい変化は、後者の方が持続的であり、かつては個人の活動であったコンテンツを中心にアイデンティティとマルチプレイヤーコミュニティを築くことになります。

全体として、私たちの歴史上最も偉大な物語は線形メディアで語られていますが、未来を見据えると、ゲームとインタラクティブメディアが未来の物語の語り場となるでしょう。したがって、私たちは次の世代で最も重要な物語会社がここで誕生すると信じています。

インタラクティブビデオ:物語とゲームの融合

ゲームが文化の中で主導的な地位を占めていることを考慮し、私たちは次のピクサーが物語とゲームを融合させたメディアフォーマットを通じて現れると信じています。私たちが見ている一つの大きな可能性のあるフォーマットはインタラクティブビデオです。

まず、インタラクティブビデオとは何か、そしてそれはビデオゲームとどのように異なるのでしょうか?ビデオゲームでは、開発者が一連のリソースをゲームエンジンに事前にロードします。例えば、『スーパーマリオブラザーズ』では、アーティストがマリオのキャラクター、木々、背景をデザインしました。プログラマーは、プレイヤーが「A」ボタンを押したときにマリオが50ピクセルジャンプするように設定しました。ジャンプフレームは従来のグラフィックパイプラインを使用してレンダリングされます。これにより、ゲームの構造は高度に決定的で計算的になり、開発者が完全に制御します。

一方、インタラクティブビデオは完全に神経ネットワークに依存してリアルタイムでフレームを生成します。創造的なプロンプト(テキストや代表的な画像である可能性があります)を除いて、リソースをアップロードしたり作成したりする必要はありません。リアルタイムAI画像モデルは、プレイヤーの入力(例えば「上」ボタン)を受け取り、次に生成されるゲームフレームを確率的に推測します。

インタラクティブビデオの展望は、テレビと映画のアクセス可能性を物語の深さと融合させ、同時にビデオゲームのダイナミックでプレイヤー主導のシステムを組み合わせることにあります。 誰もがテレビを見て線形の物語を追う方法を知っています。プレイヤーの入力に基づいてリアルタイムで生成されたビデオを追加することで、私たちは個別化され、無限のゲーム体験を創造できます。これにより、メディア作品はファンを数千時間引きつけることができるかもしれません。ブリザードの『ワールド・オブ・ウォークラフト』は20年以上にわたり、現在でも約700万のサブスクリプションユーザーを保持しています。

インタラクティブビデオは、さまざまな消費方法も提供します。観客はテレビ番組を視聴するようにコンテンツを簡単に楽しむことも、他の時にモバイルデバイスやコントローラーで積極的にゲームをプレイすることもできます。ファンができるだけ多くの方法でお気に入りの知的財産の宇宙を体験することは、クロスメディアの物語の核心であり、知的財産への親密感を高めるのに役立ちます。

過去10年間、多くの物語作家がインタラクティブビデオのビジョンを実現しようと試みてきました。初期のブレークスルーの一つは、テイルテイルの『ウォーキング・デッド』です。これはロバート・カークマンの漫画シリーズに基づいたインタラクティブ体験で、プレイヤーはアニメーションシーンの展開を見ながら、重要な瞬間に対話やクイックタイムイベントを通じて選択を行います。これらの選択、例えばゾンビ襲撃の際にどのキャラクターを救うかを決定することは、個別化された物語のバリエーションを生み出し、毎回のゲーム体験をユニークなものにします。『ウォーキング・デッド』は2012年にリリースされ、2800万本以上の売上を記録しました。

2017年、Netflixもインタラクティブビデオの分野に参入しました。アニメ作品『猫の本』から始まり、最終的には高評価を得た『ブラック・ミラー:バンダースナッチ』をリリースしました。これは実写映画で、観客は若いプログラマーがファンタジー書籍をビデオゲームに適応する過程で選択を行います。バンダースナッチはホリデー現象となり、熱心なファンを惹きつけ、映画のすべての可能な結末を記録するためのフローチャートを作成しました。

しかし、バンダースナッチと『ウォーキング・デッド』は、肯定的な評価を受けたにもかかわらず、生存の危機に直面しました。フォーマットを定義する無数の分岐ストーリーを手動で作成する時間とコストはあまりにも高すぎました。テイルテイルが複数のプロジェクトに拡大する中で、彼らは開発者の間に過労文化を築き、開発者は「疲労と燃え尽き」を訴えました。物語の質は影響を受けました。『ウォーキング・デッド』の初期のMetacriticスコアは89、しかし4年後にテイルテイルが彼らの最大のIPの一つ『バットマン』をリリースしたとき、彼らは満足のいく64点を獲得しました。2018年、テイルテイルは破産を発表し、持続可能なビジネスモデルを確立できませんでした。

『バンダースナッチ』の場合、制作チームは250本のビデオクリップを撮影し、映画の5つの結末を説明するために5時間以上の映像を撮影しました。予算と制作時間は、標準的な『ブラック・ミラー』エピソードの2倍であると報告され、プロデューサーはプロジェクトの複雑さを"同時に4エピソードを制作する"のに相当すると述べました。最終的に2024年、Netflixはインタラクティブ特別番組部門を閉鎖し、従来のゲームの制作に移行することを決定しました。

現在まで、インタラクティブビデオプロジェクトのコンテンツコストはゲーム時間と線形の関係にあります。これを回避する方法はありません。しかし、生成的人工知能モデルの進歩は、インタラクティブビデオのスケール化を推進する鍵となる可能性があります。

生成モデルはインタラクティブビデオをサポートするのに十分な速度にすぐに達するでしょう

最近の画像生成モデルの蒸留における進展は驚くべきものです。2023年には、潜在的一貫性モデルとSDXL Turboのリリースにより、画像生成の速度と効率が大幅に向上し、高解像度レンダリングが1ステップで可能になり、以前は20〜30ステップ必要だったものが、コストも30倍以上削減されました。生成ビデオのアイデア、すなわちフレーム間の変化を持つ一貫した画像の連続体が、突然非常に実行可能になりました。

今年初め、OpenAIはソラというテキストからビデオへのモデルを発表し、最大1分間のビデオを生成できることを広く報じられました。視覚的一貫性を確保しながら。すぐに、Luma AIは、120秒で120フレーム(約5秒のビデオ)を生成できるより高速なビデオモデルDream Machineを発表しました。Lumaは最近、わずか7週間で驚異的な1000万ユーザーを獲得したことを共有しました。先月、Hedra LabsはCharacter-1を発表しました。これは、90秒で60秒のビデオを生成できるキャラクター中心のマルチモーダルビデオモデルで、豊かな人間の感情と声を表現します。そして、Runwayは最近、Gen-3 Turboを発表しました。これは、わずか15秒で10秒のクリップをレンダリングできるモデルです。

今日、野心的な映画製作者は、テキストプロンプトや参照画像から数分の720p HDビデオコンテンツを迅速に生成し、開始または終了のキーフレームと組み合わせて具体性を高めることができます。Runwayはまた、拡散生成されたビデオに対してより細かい制御を提供する編集ツールのセットを開発しており、フレーム内カメラ制御、フレーム補間、モーションブラシを含みます。LumaとHedraも、間もなくそれぞれのクリエイター向けツールキットを発表する予定です。

制作ワークフローはまだ初期段階にありますが、これらのツールを使って物語を語っているコンテンツクリエイターに出会いました。Resemblance AIは、Luma、Midjourney、Eleven Labsを使用して制作した、引き込まれる3分間の第二次世界大戦の代替歴史物語Nexus 1945を作成しました。独立映画製作者Uncanny Harryは、Hedraと共にサイバーパンク短編を制作し、クリエイターたちは音楽ビデオ、予告編、旅行ビデオブログ、さらにはファーストフードのハンバーガー広告まで制作しています。2022年以降、Runwayは毎年AI映画祭を開催し、10本の優れたAI制作短編を選出しています。

特に指摘すべきは、現在でもいくつかの限界が存在することです。プロンプトから生成された2分間のクリップと、プロのチームが制作した2時間の長編映画の間には、物語の質と制御において明らかなギャップがあります。プロンプトや画像に基づいてクリエイターが望むコンテンツを生成することはしばしば困難であり、経験豊富なプロンプトエンジニアでさえ、生成されたコンテンツの大部分を放棄することがよくあります。AIクリエイターAbel Artは、1分間の一貫したビデオを生成するのに約500本のビデオが必要であると報告しています。画像の一貫性は、連続ビデオが1〜2分再生された後に失われ始めることが多く、通常は手動編集が必要です。これが、今日のほとんどの生成ビデオの長さが約1分に制限されている理由です。

ほとんどのプロのハリウッドスタジオにとって、拡散モデル生成のビデオは、前期制作におけるストーリーボードとして使用され、シーンやキャラクターの外観を視覚化することができますが、現場での撮影を代替するものではありません。後期制作においても、AIを使用して音声や視覚効果を処理する機会がありますが、全体的に見て、AIクリエイターのツールキットは、数十年の投資を経た従来のワークフローと比較して、まだ初期の発展段階にあります。

短期的には、生成ビデオの最大の機会の一つは、インタラクティブビデオや短編のような新しいメディアフォーマットの発展にあります。 インタラクティブビデオは、プレイヤーの選択に基づいて短い1〜2分のクリップに分割され、通常はアニメーションまたはスタイライズされ、低解像度の素材を使用できます。さらに重要なのは、これらの短いビデオを拡散モデルで作成するコストは、テイルテイルやバンダースナッチの時代よりもコストパフォーマンスが良いということです。Abel Artは、Lumaからの1分間のビデオのコストを125ドルと見積もっており、これは映画の撮影を1日レンタルするのと同等の費用です。

今日、生成ビデオの質は一貫していないかもしれませんが、ReelShortやDramaBoxのような垂直短編ビデオの人気は、視聴者が低制作価値のシリーズ短編テレビに対する需要を証明しています。批評家が撮影がアマチュアで脚本が公式化されていると不満を言っているにもかかわらず、ReelShortは3000万回以上のダウンロードを推進し、毎月1000万ドル以上の収益を上げ、『禁忌欲望:アルファの愛』のような数千のミニシリーズを展開しています。

インタラクティブビデオが直面している最大の技術的障害は、リアルタイムでコンテンツを生成するために十分な速さでフレームを生成することです。Dream Machineは現在、約1秒間に1フレームを生成しています。現代のゲーム機の最低限の受け入れ可能な目標は安定した30 FPSであり、60 FPSがゴールデンスタンダードです。PABなどの技術の助けを借りて、特定のビデオタイプでは10〜20 FPSに向上させることができますが、まだ速度が不足しています。

現状:インタラクティブビデオの状況

私たちが見ている基盤となるハードウェアとモデルの改善速度を考慮すると、商業的に実行可能な完全生成のインタラクティブビデオまでには約2年の距離があると推定しています。

今日、私たちはマイクロソフト研究やOpenAIなどの参加者が研究分野で進展を遂げ、インタラクティブビデオのエンドツーエンドの基盤モデルに取り組んでいるのを見ています。マイクロソフトのモデルは、完全に「プレイ可能な世界」の3D環境を生成することを目的としています。OpenAIは、Soraのデモを示し、このモデルが「ゼロショット」でMinecraftのシミュレーションを行うことができると説明しました。「Soraは、Minecraft内のプレイヤーの行動を同時に制御し、高忠実度で世界とその動的要素をレンダリングできます。」

2024年2月、Google DeepMindは独自のエンドツーエンドインタラクティブビデオ基盤モデルGenieを発表しました。Genieのユニークな点は、その潜在的な動作モデルであり、これは2つのビデオフレーム間の潜在的な動作を推測します。30万時間のプラットフォームビデオで訓練されたGenieは、キャラクターの動作を認識する方法を学びました。例えば、障害物を越える方法です。この潜在的な動作モデルは、ビデオのトークン化器と組み合わされ、次のフレームを予測する動的モデルに入力され、インタラクティブビデオを構築します。

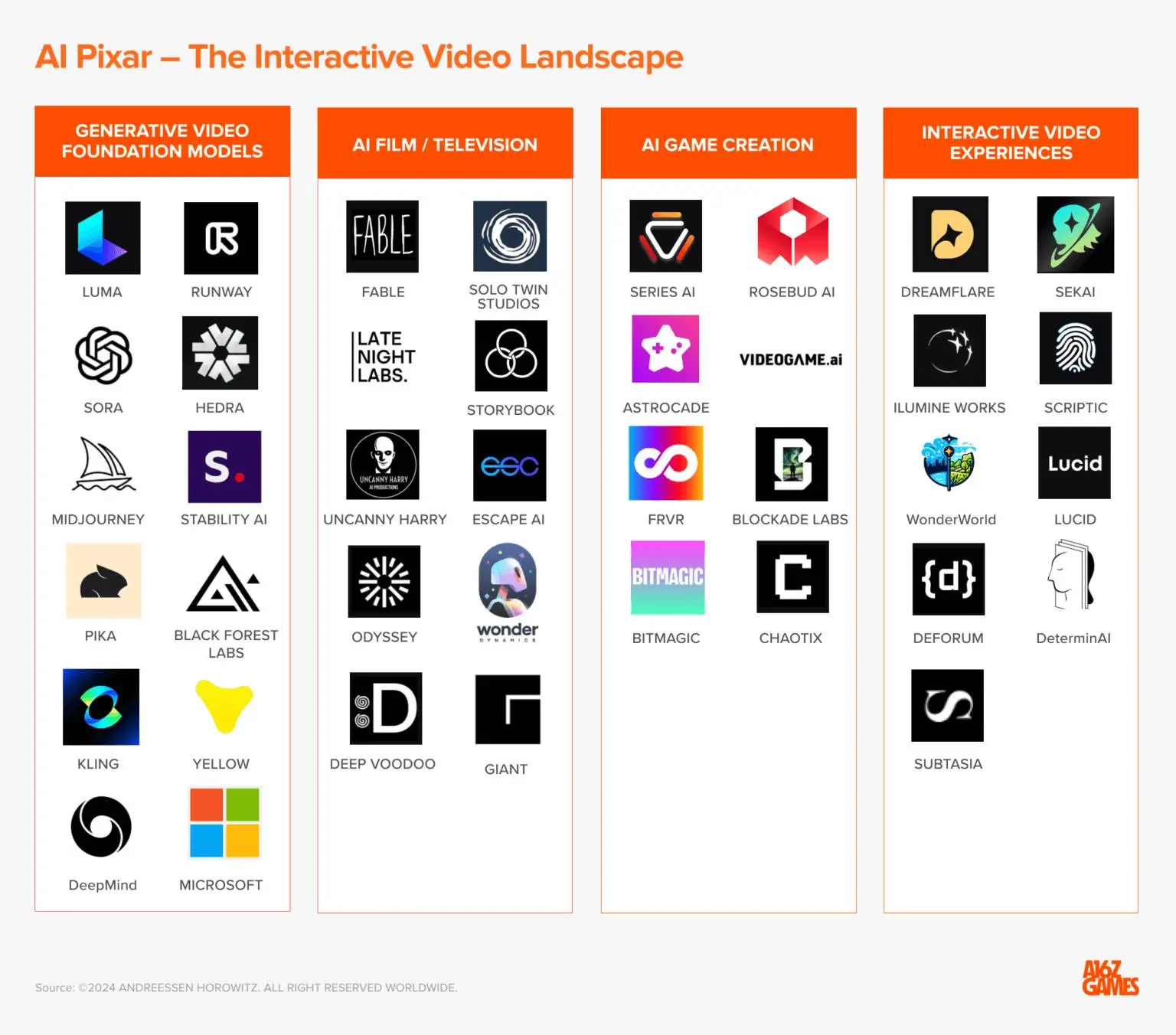

アプリケーションレベルでは、いくつかのチームが新しいインタラクティブビデオ体験を探求しています。多くの企業が、現在のモデルの限界を考慮して、生成型映画やテレビ番組の制作に取り組んでいます。また、いくつかのチームがAIネイティブゲームエンジンにビデオ要素を追加しています。

IlumineのLatensは、ユーザーが夢の中を歩くときにリアルタイムで映像コンテンツを生成する「明晰夢シミュレーター」を開発しています。このわずかな遅延は、超現実的な体験を生み出すのに役立ちます。オープンソースコミュニティDeforumの開発者たちは、没入型インタラクティブビデオの現実世界の装置を作成しています。Dynamicは、ユーザーが第一人称視点でロボットを制御し、完全に生成されたビデオを使用するシミュレーションエンジンを開発しています。

テレビや映画の分野では、Fable StudioがShowrunnerを開発しています。これはAIストリーミングサービスで、ファンが人気番組の自分バージョンを改編できるようにします。Fableの概念実証プロジェクト『サウスパークAI』は、昨年の夏に放送され、800万回の視聴を達成しました。Solo TwinとUncanny Harryは、最前線に位置するAI映画制作スタジオです。Alterverseは、D&Dに触発されたインタラクティブビデオRPGを作成し、コミュニティが次に何が起こるかを決定します。Late Night Labsは新しいトップ映画制作会社で、AIを創作プロセスに統合しています。Odysseyは、4つの生成モデルによって駆動されるビジュアルストーリーテリングプラットフォームを開発しています。

映画とゲームの境界が曖昧になるにつれ、AIネイティブゲームエンジンやツールが登場し、クリエイターにより多くの制御を与えることになります。Series AIは、AIゲーム開発のためのエンドツーエンドプラットフォームRho Engineを開発し、そのプラットフォームを利用して主要な知的財産権保有者と共同でオリジナル作品を開発しています。また、Rosebud AI、AstrocadeやVideogame AIが提供するAI創作キットは、新人プログラマーやアーティストがインタラクティブ体験を迅速に制作できるようにします。

これらの新しいAI創作キットは、物語を語るための市場機会を生み出し、新しいタイプの市民クリエイターがプロンプトエンジニアリング、ビジュアルスケッチ、音声認識を利用して彼らの想像力を具現化できるようにします。

誰がインタラクティブ版ピクサーを作るのか?

ピクサーは、コンピュータと3Dグラフィックスの基盤技術革新を利用して、象徴的な会社を創造しました。今日、生成AIの分野でも同様の波が起こっています。しかし、重要なのは、ピクサーの成功は大部分が『トイ・ストーリー』と、ジョン・ラセターが率いる世界クラスのストーリーチームによって作られたクラシックアニメーション映画に起因していることです。人間の創造性が新しい技術と結びつくことで、最も優れた物語が生まれます。

同様に、私たちは次のピクサーが世界クラスのインタラクティブストーリーのスタジオであり、トップテクノロジー企業になる必要があると信じています。 AI研究が急速に進展する中、クリエイティブチームはAIチームと密接に協力し、物語とゲームデザインを技術革新と融合させる必要があります。ピクサーは、アートとテクノロジーを融合させ、ディズニーと協力関係を築く独自のチームを持っています。今日の機会は、新しいチームがゲーム、映画、AIの分野を融合させることにあります。

明確にしておくべきは、これは技術に限らず大きな挑戦であるということです。このチームは、人間のストーリーテラーとAIツールが協力して働く新しい方法を探求し、彼らの想像力を強化する必要があります。また、モデルの訓練に使用されるすべてのデータに対する所有権をクリエイターが証明できない限り、AI生成の創造物の法的所有権と著作権保護は依然として不明確です。訓練データの背後にいる原作者、アーティスト、制作人への補償の問題も解決を要します。

しかし、今日明確なのは、新しいインタラクティブ体験への需要が非常に高いということです。長期的には、次のピクサーはインタラクティブな物語を創造するだけでなく、完全な仮想世界を構築することができるでしょう。 私たちは以前、無限ゲームの可能性を探求しました。これは、リアルタイムレベル生成、個性化された物語、インテリジェントエージェントを融合させた動的な世界であり、HBOの『ウエストワールド』の構想に似ています。インタラクティブビデオは、『ウエストワールド』を現実にするための最大の課題の一つ、すなわち大量の個別化された高品質のインタラクティブコンテンツを迅速に生成することを解決します。

いつの日か、AIの助けを借りて、私たちは物語の世界を構築することで創作プロセスを開始するかもしれません。これは、私たちが完全に形成された知的財産の世界を想像し、キャラクター、物語の線、ビジュアルなどを含むものであり、次に観客や特定の状況に提供したいさまざまなメディア製品を生成することになります。これはクロスメディアの物語の最終的な発展であり、従来のメディア形式の境界を完全に曖昧にします。

ピクサー、ディズニー、マーベルは、ファンのアイデンティティの核心部分となる忘れがたい世界を創造することができました。次のインタラクティブピクサーの機会は、生成AIを利用して同じ目標を達成することにあります。すなわち、新しい物語の世界を創造し、従来の物語形式の境界を曖昧にし、前例のない世界を生み出すことです。